René Bauer (gamelab.zhdk.ch, gamedesign.zhdk.ch) und Chris E. Leisi (IASpace, gamedesign.zhdk.ch)

Es ist ein lang anhaltender Trend, Beamer bzw. allgemein Grossdisplays zu nutzen fuer Games. Wer wollte nicht schon immer auf riesigen Leinwänden Actionspiele spielen etwa 3D-Games. Leider sind dann die meisten Games doch darauf ausgelegt, dass man alles im Blick ‚haben‘ muss. Wenige Spiele nutzen die Vor- und Nachteile von BigScreens (SplitScreen-Games mal ausgenommen). Denn dafuer braucht es im besten Fall auch neue Spielkonzepte (wie etwa bei SuperHapyyFunTimes oder NanoRunners, 2012 vgl. auch AirConsole – das allerdings meist auf 8 Spieler* beschränkt).

In Sachen Experiences sind Beamer/BigScreens aber schon länger anzutreffen. Vieles begann im Privaten mit teueren VirtualReality-Cave-Experiences in den 80/90er Jahren (vgl. dazu Exercube), wurde erweitert in interaktiven Installationen (wie etwa Mitläufer ZHdK, 2008). Virtual Reality war als Begriff in den 80/90er Jahren gebräuchlich fuer alle nicht-analogen Welten: also Computerspiele oder eben auch 3D-Darstellungen. Die dreidimensionale Nutzung des Raums als Projektionsflaeche wird seit mehr als einem Jahrzehnt im Projectionmapping benutzt (im Gamelab-Zusammenhang etwa auf Autos 2016, PodRacerZ – 3D-Modelle 2018 oder in Pinballs PinballZ 2016 oder im Mix bei HammerToFall Games@museum 2018).

All diese Experimente und „Spiele“ trenn(t)en den Input vom Display (wie das die meisten Games ‚machen‘). Der Mensch war/wird zwar teilweise mit dem Körper als Controller eingebunden, aber kontrolliert letztlich den Avatar auf dem Display. Viele Kinectinstallationen funktionieren auch nach diesem Trennprinzip. Diese Trennung hat viele Vorteile und geht einigen Problemen (Abbildung, Schatten, keine Beeinflussung, Delays) aus dem Weg – steht aber ganz im Gegensatz zur Spielkultur, in denen der Körper Controller, Spielfigur auch als physikalische Box Teil des Spielfeldes sein kann. Man findet dies bei vielen Sportspielen bis hin zu Spielen wie ‚Lumpensack‘. Anders gesagt, der Körper lässt sich nicht auf einen Punkt ohne Masse, Gewicht, Kraft und Energie kondensieren in analogen Welten.

Display und Interface als DisplayInteraktionsRaum

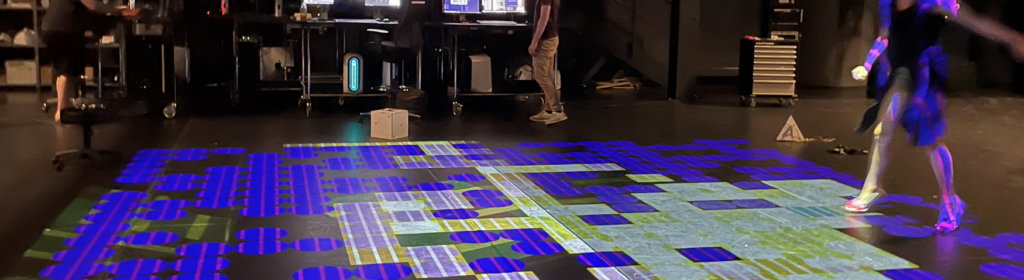

Kombiniert man den Displayraum, den Interaktionsraum und den Spieler* als Figur in einem Raum, fällt diese kuenstliche Trennung wieder in sich zusammen. Der Raum wird durch nun verschiedene analoge und digitale Regeln nun viel eingeschränkter oder anders gesagt komplexer. Es ueberlagern sich verschiedenste ‚Regelsets‘ (analoge (Festkörper, biologische Körper, soziale) und digitale). Der Workshop nutzte deswegen im Immersive Arts Space das Mocapsystem Optitrack, eine Bodenprojektion und die GameEngine Unity.

GamesInMovement – Workshop

Der Workshop GamesInMovement ging als (weiterer) Workshop der Fragen nach, was fuer Spiele lassen sich mit dem oben beschriebenen Zusammenfall weiterentwickeln, neu erfinden. Welche Motivationsdesigns lassen sich sogar aus der Realwelt ableiten, wenn man den Display- und Interaktionsraum verschmilzt. Die Ausschreibung findet sich hier.

Gruppengrösse

Wer Workshops organisiert, ist immer hin- und hergerissen in Sachen Aufwand und Ertrag oder anders gesagt: zwischen grossen Gruppen und damit Reichweite oder zwischen kleinen Gruppen und eher vielleicht feinen Projekten. Ganz zu schweigen davon, was die „Bespassung“ und grosse Gruppen fuer einen Aufwand mit sich bringen.

Im Fall von GamesInMovement nahmen 8 Personen teil. 2 davon wollten einfach nur mal ‚reinsehen‘ und blieben einen Tag. Dies ermöglichte nach einem Tag Einfuehrung und einem Prototypen, dass jede Gruppe an einem eigenen Entwicker-PC mit Anschluss an die Bodenprojektion arbeiten konnte.

Workshopgruppenzusammensetzung

Die Zusammensetzung war: 2x GameDesign ZHdK, (2+1)x ZHaW Informatik, 1 Person Grafik/Performance ZHdK extern und 2 x Leitung mit Erklärungen, Hilfe zur Selbsthilfe, Mentoring und eigenen Experimenten. Als zusätzliche Testspieler waren 2 Mitarbeiter* der ZHdK dabei. Fuer einen Tag war zusätzlich noch ein Externer dabei.

Technik & Möglichkeiten

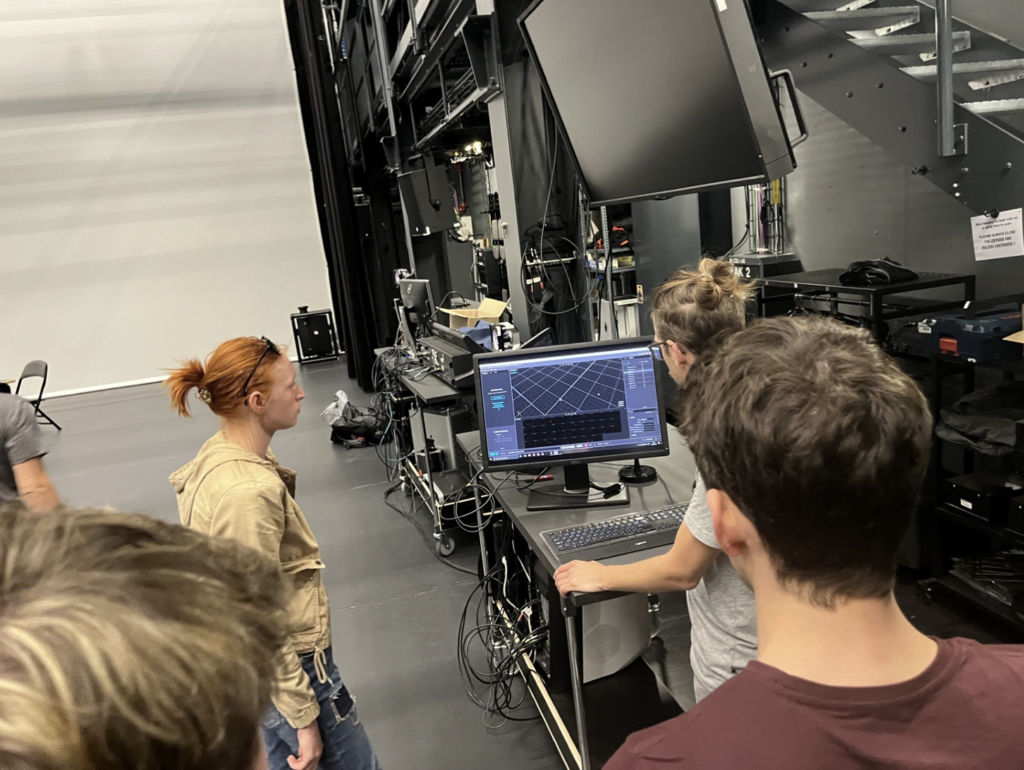

Als Technik kam das HighEnd-MotionCaputring-System mit 40 Kameras zum Einsatz. Die Positions-Daten wurden von einem zentralen Server an die einzelnen Workstations gestreamt, dort verarbeitet per Unity und der Output als Rendertexture an den Computer mit den Beamern geschickt und da dargestellt (gesplittet auf zwei Beamer). Bei einem der Computer war eine Leinwandprojektion optional direkt möglich.

Es wurde nicht das MotionTracking fuer Körper benutzt, sondern einzelne Objekte. In der Mehrheit der Fälle wurde mit eigenen Reflektor-Dreiecken (3 Reflektor-Punkte genannt Rigidbodies) gearbeitet, die je individuell nach Position und Ausrichtung getrackt wurden und die je eine spezifische ID enthielten, die in Unity ausgelesen werden konnte (Position und Ausrichtung).

Die Vorteile sind dabei gross. Jedes Objekt kann durch mindestens 3 Reflektoren getrackt werden, diese können wiederum an anderen Objekten oder Körperteilen befestigt werden Dadurch ist die Bandbreite möglicher Anwendungen und schnelles Prototypen ueberhaupt erst richtig effizient (vs. FullbodyTrackig). Steuert man das Ganze mit Kopf oder Fuss oder gar mit einem Besen. Alles schnell und einfach umsetzbar.

Daraus folgt auch, dass man in der Entwicklungsphase viel unterwegs ist – gerade weil es um interaktive Prototypen geht.

Das UnityProjekt bildete die realen Metermasse und die Ausrichtung des Raumes ab. Der Output wurde per gerenderten Texture an den Beamer der Bodenprojektion geschickt und dargestellt. Der Delay auf der Bodenprojekten war vorhanden (kann aber optimiert werden), die direkte Anbindung des Leinwandbeamers erzeugte technisch weit weniger Latenz.

Die Bodenprojektionsfläche war 6×6 Meter gross. Das Tracking selbst war allerdings grösser. Nicht zu unterschätzen sind die Möglichkeiten mehrere Objekte gleichzeitig zu tracken (etwa als Multiuser-Apps oder mehrere kontrollierbare Objekte per hin- und herschieben tracken) und die Objekte können teilverdeckt sein. Die Spieler* hatten in dem Setting auch einen Schatten (oder zwei). All zu schnell vergisst man bei der Entwicklung mit Projektionen aber, dass ja der projezierte Raum auch gestaltbar ist. Hier scheint der Diskurs und damit die Ideen noch viel zu vorgespurt, es ist die Idee der „flachen“ Projektionsflächen. Eine Auswirkung davon, dem IASpace fehlen weiterhin etwa „Turnmatten“ oder Turnkästen.

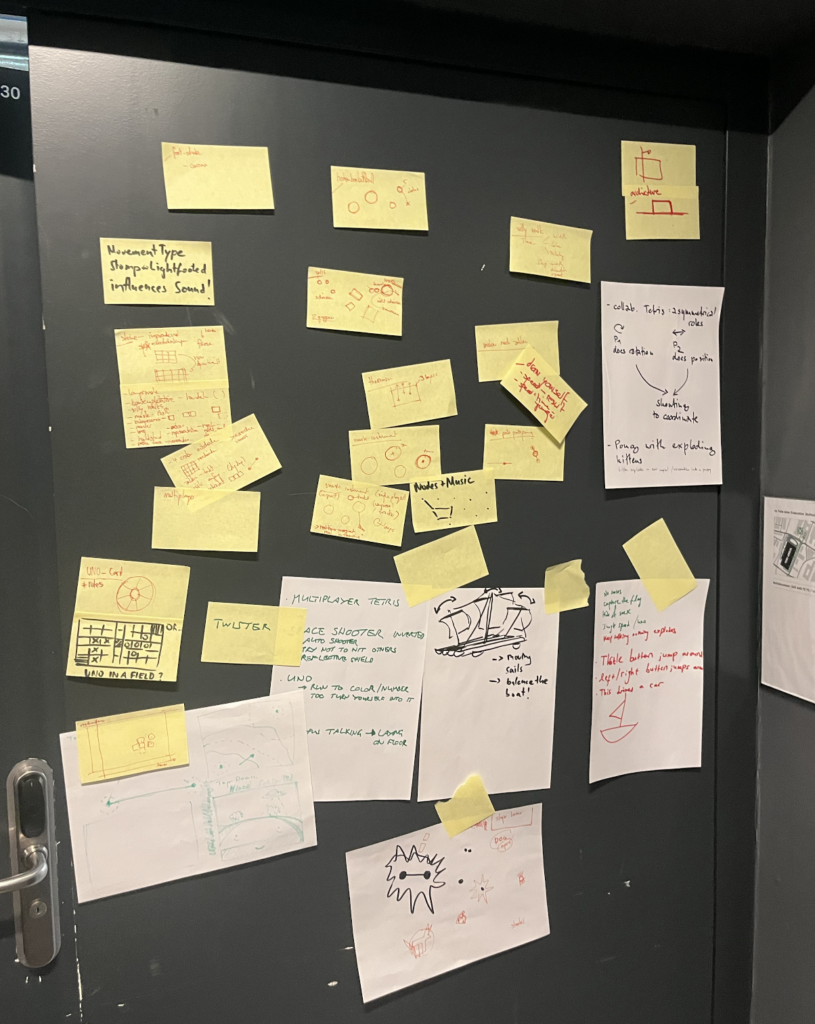

Ideation

Die Ideation war zweistufig. Die Entwicklung von Ideen, die Präsentation und die anschliessende Bildung von Gruppen anhand der Ideen. Die Entwicklung der Ideen wurde in 2x sich wechselnden Gruppen durchgefuehrt. Jeder* konnte zu jederzeit auch eigene Ideen zusätzlich einbringen.

Zuerst wurden Ideen ausgelesen, die am ersten Tag umgesetzt werden konnten. Dies ermöglichte es, ein Feeling fuer das Setting zu bekommen, was möglich war (Lines, CatchMeFirst).

Die Ideen verteilten sich auf Themen wie Instrumente, kooperative Gameplays (Schiffe, Floss etc), Alltagsuebersetzungen in XAR, Neukreationen von Gesellschaftspspielen, … etc.

Die konkreten Experimente/Games/Artefakte

Im Nachfolgenden sollen die Spiele kurz dargestellt werden und die Findings festgehalten werden. Die Idee dahinter: Die Spiele sollen such- und lesbar werden. Denn de facto werden diese Spiele (wie viele andere solcher Experimente) ausser im IASpace nirgendwo mehr spielbar sein. Dabei handelt es sich durchaus im Gamedesignbereich um Anwendungsforschung im Bereich des Möglichkeitsraumes von XAR-Games.

(Mit * sind die Titel markiert, wo der letzte Titel unklar war.)

Lines* (Leonard L) – Einerspiel- oder Zweierspielerspiel

So wurde zuerst versucht das „Springen“ der einzelnen Spieler*innen zu tracken, was sich mit den Latenzen aller einzelnen technischen Schnittstellen als schwierig darstellte.

Die spielmechanische Lösung war am Ende, den getrackten Fuss hochzuheben und auf einem Bein zu stehen. Dies bringt automatisch eine Performance fuer die Zuschauer mit sich.

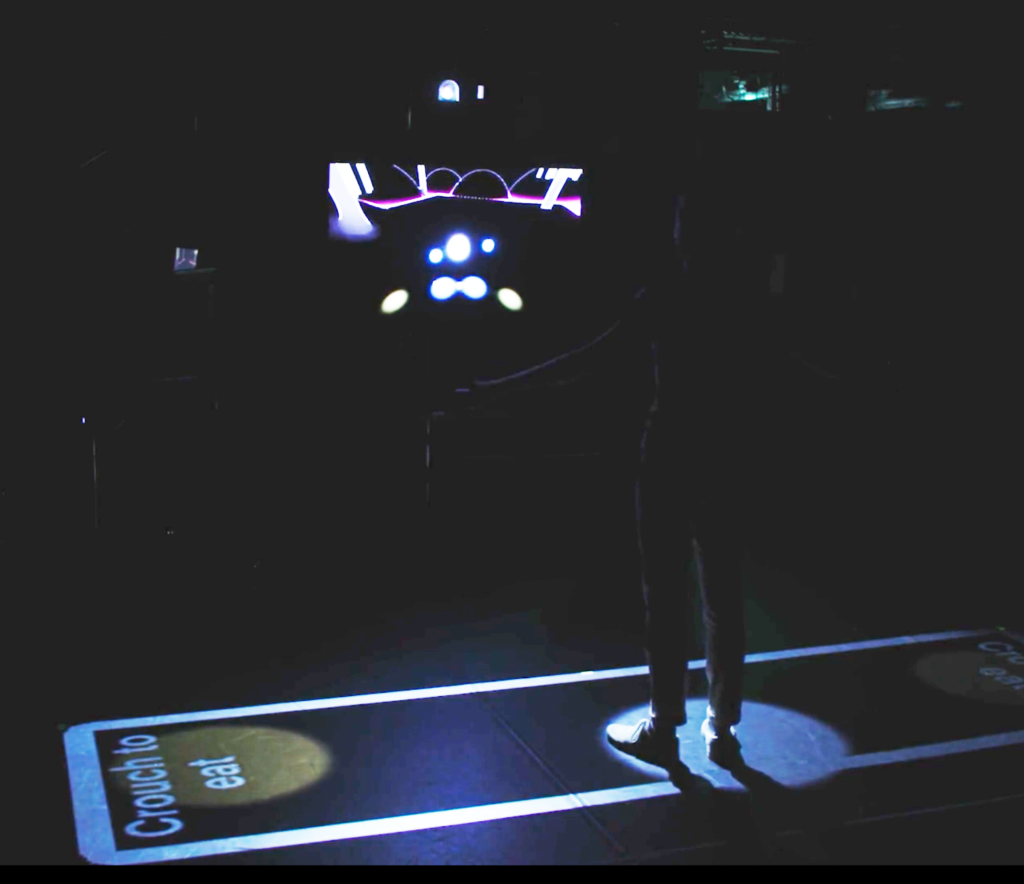

Catch me first (Agata Tselesh) – Zweispielerspiel

Die Spielmechanik ist einfach: Wer zuerst 4-5 Punkte gefangen hat, gewinnt. Der zufällig erscheinende weisse Punkte muss beruehrt werden (Kopf der Spieler*innen als Avatar). Die Anzahl der Punkte wird als gefuellter Kreis um sich selbst dargestellt. Die Mechanik ist konkret – wie im Video sichtbar – weit komplexer: Es geht um ein dauerendes Suchen, um sich selbst herum (Ruecken), der eigene Körper, sowie der andere Körper sind ein (visuelles) Hindernis, ein Schneller-Sein und ein Abwägen, ob sich ein Spurt lohnt. Zusätzlich kann diese Jagd auch schnell zu Zusammenstössen fuehren. Selbstverständlich lässt sich dieses Spiel bei grösserem Raum einfach skalieren.

Fuer die Zuschauer* ist das Spiel recht attraktiv, passiert es doch auf einem kleinen Raum, ist schnell und sieht der Zuschauer* immer das gesamte Feld („Hey siehst du das nicht?“). All dies fuehrt zu einer Art Performance fuer Zuschauende. Etwas was ja auch von vielen Performances benutzt wird.

UNOCircles (C. Leisi) – Zweierspielerspiel

Die Spielmechanik kommt von UNO und verräumlicht sie. Die zu „erreichende“ Karte ist in der Mitte etwa Blau 4. Der Spieler* hat am Anfang keine Karte (grau und eine 0). Er muss nun also sich die richtige Farbe oder die richtige Nummer suchen (Wobei es sicher eine Farbe und eine Zahl hoeher als 0 haben muss). Diese findet er rotierend um die Mitte der Ablagekarte herum. Der Spieler* ist/ repräsentiert also die aktuelle Karte (Farbe und Nummer), die er hält. Man könnte auch sagen: Er ist diese Karte. Die Visualisierung kann auch als Mittel benutzt werden, die zu erreichende Karte zu verdecken.

Das sich entwickelnde Spiel ist hektisch, geprägt vom Finden (Herumschauen) der Karte (Farbe und Zahl), der Nutzung des eigenen Körpers und die Konkurrenz zum anderen Spieler*. Und letztlich kämpft man schon bald durch das Stop&Go mit der Muedigkeit des eigenen Körpers und seiner Aufmerksamkeit.

Fuer die Zuschauer entsteht wiederum ein attraktives Game wie bei SNAKE.

CatchTheDiamond (Ronnie L, Simon B.) – Zweispielerspiel

Catch the diamond ist ein Spiel, dass das Tempo in seiner Spielmechanik rausnimmt – zumindest das Sich-Schnell-Bewegen. Es ist Grid basiert. Zu zweit muss man die Grossmutter dazu bringen, den „Diamond“ zu stehlen. Die Interaktionsmöglichkeit ist dabei je ein Laser. Es gilt Objekte zu aktiveren und der Grossmutter den Weg zum Diamanten frei zu machen. Den ersten Laser (Drehung, Position) steuert man per getracktem Drehhocker, den zweiten einfach im Stehen.

AbsoluteTetris (Simon B, R. Bauer) – Zweispielerspiel

Absolute Tetris ist die Frage nach „Wie verändern sich Games durch ihre Controls“. Mary Flanagan hat die Bedingtheit der Games und des Controllers dazu, mit ihrer GameArtArbeit GiantJoystick radikal beantwortet. Aus jedem Einzelspielerspiel wird ein Multiplayergame, da der Joystick riesig ist und die Spielenden ihn nicht mehr alleine bedienen können.

AbsoluteTetris verändert die Controls eines Tetris, indem es:

a) die Controls physikalisiert (die Position wird von Menschen im Raum festgelegt) b) Controls werden gesplittet (eine Person spielt die Position, eine andere die Rotation) c) in absolute Controls verwandelt (Position wie auch Rotation sind fuer eine Position festgelegt)

d) der Raum am Boden fuer beide Spieler* uebereinanderliegt und man schwer aneinander vorbeikommt.

Experimentiert wurde auch mit Objekten, die man als Controller hin- und herschieben musste zur Kontrolle bis hin zu schweren Gewichten. In der letzten Version wurde statt einer Bodenprojektion eine Wandprojektion verwendet, dies verstärkte auch den Eindruck der fallenden Steine. Das Spiel verwendete eine TetrisVersion aus dem AssetStore, die angepasst wurde.

WalkTheTiles (R. Bauer) – Einspielerplay

Die Spielmechanik hinter WalkTheTiles versucht eine Alltagsbeschäftigung in XAR zu uebersetzen. Die Mechanik kennen alle Personen, die an Haltstellen herumtigern: Man geht nach einem eigenen freigewählten Muster auf Steinen. Das Ganze ähnelt aber auch eher einem immersiven Play als einem Game.

In WalkingTheTiles wurde bis anhin nur die Spielfläche umgesetzt. Das Tracking ermöglicht, das Einfärben von Kreisen in einem Raster zu Blöcken. Der Rythmus wird dabei per Musik vorgegeben. Die Bloecke sind 30×30 cm gross, so dass beide Fuesse hineinpassen (Noch auszuprobieren: Grösse von 60×60). Das Spielfeld ist zufällig mit Löchern versehen. Der Spieler (nicht digital kontrolliert) sollte sich immer in einem Winkel und Takt bewegen.

Das offene Konzept ermöglicht aber auch, dass die Personen sich eine eigene Aufgabe (=Regeln) setzen – etwa den Takt einer Musik.

Das Experiment stellt letztlich auch die Frage nach. Wie sehr soll etwas ein Toy oder ein Instrument sein, in das man sich einklinken kann und das Dinge offen lässt.

Instruments (Agata Tselesh) – Mehrspielerinstrument

Die Idee dieses verräumlichten Instrumentes begann mit dem Theremin-Instrument und wurde ausgebaut um Aufnahmepunkte, Resetter, Verstärkungstriggers etc. Das Gameplay ist – auch beim Zusehen – etwas zwischen Experiment, Play, Instrument und Performance.

Besonders interessant wird das Ganze, wenn die Objekte erweitert werden und die Bewegungen Pendeln oder Kreisen sind eines Gegenstandes. Einen Moment ist sogar die Praxis der Beräucherung mit Myrrhe einer Kirche als Bewegung im Raum.

ChangeTheAvatar – MansplainingAvatar (R. Bauer)

MotionCapturing-Inputs ermöglichen auch neue Arten von Inputs und Kontrolle. Die Idee hier: Je nach Bewegung verändert sich der Avatar im Spiel. Ist man auf allen Vieren unterwegs, ist man ein Tiger oder ein Stuhl, als Zweibeiner ein Mensch etc. Die einfachste Art dies zu tracken, ist etwa das Gehen zu tracken bzw. zwei Fuesse. Angewendet wurde dies hier sehr stereotyp in „MansplainingAvatar“: Mit Tippelschritten ist man eine Kriegerin, breitbeinig ein Catcher. Die Grösse ist zusätzlich noch abhängig von einem Sinus ueber dem Abstand zur Leinwand. Hier wurde zwar ein Gameplay entwickelt aber nicht implementiert – sondern eher der Frage nachgegangen, wie lässt sich der Effekt konkret nutzen.

Ausstehend ist hier deshalb noch die Implementation der Idee, dass man mit Tippelschritten Energie sammelt, die man als Breitbeiniger wiederum ‚verspruehen‘ kann, um etwa die Gegner zu vernichten.

Findings

Das Regelwerk von XAR-Games mit Verschränkung von Spielfeld, Display und Spieler* fuehrt ganz viele Regeln wieder ein und lässt dabei komplexe Settings zu. Objekte können analog, analog/virtuell oder ganz virtuell sein. Der Vorteil im Vergleich zu AR/VR ist dabei, dass alle Beteiligten inklusive der Zuschauerrolle alles ebenfalls sehen. Und dennoch ist die Perspektive der Spieler meistens eine Firstpersonperspektive. Eine Perspektive, die vorallem die anderen Spieler, Gegenstände auf dem „Spielset“, sowie den Boden im Blick hat. Dadurch entstehen analog, die Probleme, die wir aus dem Design von Firstpersonspielen bzw. AR/VR kennen: Wo bin ich? Was passiert hinter mir? Was mache ich genau?

Die analoge Regel, dass Menschen Körper haben, wird bei jedem Experiment dieses Workshops sofort klar. Diese Körper benötigen Platz und können kollidieren, was keine angenehme Sache ist und dennoch einen Reiz ausmachen. Auch kann man nicht schneller rennen/spurten, als es die eigene Kraft zulässt. Dieses Problem kennt man auch in VR-Spielen, welche sich auch zu Fitnessspielen umfunktionieren lassen. Die Spiele sind letztlich auch gefährlich und Entscheidungen können schmerzen, gerade in der Hitze des Gefechts. Insofern werden hier wirklich Meaningfull-Decisions getroffen, die im Analogen spuerbar sind. Dadurch wird das Analog-Digitale zum Realen.

Der Körper kann direkt Avatar sein oder/und einen oder viele digitalen Avatar kontrollieren. Da hier meist mit einer direkten Uebersetzung gearbeitet wird, legt man beim Spielen Weg zurueck und das eingebaute analoge Health-System kommt aus dem Tritt und man verliert Kraft und wird muede, die Konzentration lässt nach. Und so verliert man manches Spiel aus körperlichen Gruenden. All dies ist natuerlich nicht anders als in Sportspielen, GPS-Games, Kinect-Spielen oder bei VR – allderings ist hier nur ein Teil des Regelwerkes.

Schaut man sich die Trigger oder Kollisionen an, so sind hier viel mehr mögliche Kollisionen möglich: Analog-analog, analog-digital, digital-digital. Diese Regeln schränken im Design ein (oder befreien) und so gilt auch hier: Man* macht Spiele mit den Möglichkeiten und Einschränkungen und nicht etwa Spiele gegen die Möglichkeiten.

Ausblick

Fuer den Einsatz zu Hause ist das Setting weiterhin unerschwinglich. Dennoch lassen sich an diesem potentiell MultiuserHighendsystem viele Dinge ausprobieren, Spielmechaniken testen ohne auf das (privatisierte alias demokratisierte) Morgen zu warten.

Dabei wird auch schnell klar, dass etwa im Sportbereich gar nicht alles – etwa der Ball oder die Spieler – getrackt werden muessen. Es reicht oft, dass etwa das „Goal“ oder der „Korb“ sich am Boden verschiebt. Damit werden Gameplays möglich (auch fuer Einzelspieler), die so dynamisch wie moderne Computerspiele sind (siehe Snake). Es muss (und das gilt auch fuer alle anderen Spiele) nicht immer alles total kontrolliert sein. Es reicht auch vieles sozial (selbst oder durch andere Spieler*) zu kontrollieren. Und dann sagen Leute halt wieder: „Ne, das war kein Tor“ oder „Das war neben der Linie“

Wie das technisch Morgen aussehen könnte, zeigt sich etwa bei der Diplomarbeit von Lorenz Kleiser im GameDesign der ZHDK. Changing Matters nutzt einen Screen als Hauptscreen, einen Beamer fuer die Bodenprojektion und eine Kamera (Realsense), die die Bones trackt. Dadurch wird eine ganze Menge an Spielmechanik möglich.

Allerdings wird auch hier mit menschlichen Bones gearbeitet und nicht mit einfachen Knotenpunkten oder sogar Punktwolken. Das engt letztlich auch ein und stellt weiterhin den menschlichen Körper in den Mittelpunkt.

Dennoch lässt sich davon träumen, dass ein einfaches System eines Tages kombiniert mit einem Sportplatz faszinierende neue adaptive Spiele ermöglicht. Bis dahin bleibt uns nichts anderes, als auf MotiontrackingSystem gedacht fuer Filme zurueckzugreifen oder einfachere Mocap-System wie Lidar zu nutzen.

Unter Tage – zurueck im Licht

Und wer so manchen Tag unter Tage verbracht hat, wird sich bewusst, dass es noch lange gehen wird, bis wir solche Spiele im Sonnenschein spielen können.

Wer gerne den IASpace besucht im Virtuellen (im Realen ist der Zugriff schweierig), der kann das auf www.toniz.ch hier besuchen und das jederzeit. Nachfolgend geht es durchs tonizh in den Untergrund des IASpaces im IASpace.